您的位置:首页 >汽车资讯 > 汽车资讯

基于神经网络BP的车型分类系统进行车型识别技术研究研究

![]() 2022-03-31 11:10:16

来源:网络整理

2022-03-31 11:10:16

来源:网络整理

简介:国内外车型识别技术的研究现状目前国内外基于图像分析的车型识别研究的主要方向为:特征匹配算法的车型识别、神经网络的车型识别、支持向量机的车型识别。目前,基于神经网络的视频图像车型分类方法大致可以分为以下两类:(1)基于神经

本文最终采用顶长比、顶高比、前后比向量。(3)车辆分类。本文研究了基于BP神经网络的车辆分类,通过选择合适的参数,获得了更高的分类准确率。应用和仿真结果表明,实时性、准确率等性能都有所提高,车辆分类系统实现了前瞻性目标。同时,我们的方法具有以下优点:提取的特征简单,账户小,分类函数构成的BP网络简单,易于硬件实现,将关键词:智能交通系统;车辆识别;车辆检测;特征提取;

然而,无论在发达国家还是发展中国家,由于车辆保有量的不断增加,道路负荷不断增加,交通拥堵、道路拥堵、交通事故日益严重,造成社会经济损失、环境污染等问题已成为不利于社会发展的不利因素。由于我国城镇化和汽车化的快速发展,城镇化的快速推进,特别是大城市规模的扩大,带来了城市交通需求,尤其是机动车保有量的快速增长。这些问题和矛盾在我国尤为突出。,越来越扰乱城市居民的日常生活。为了解决以上问题,经过长期广泛的研究,以改善交通秩序、缓解交通拥堵、减少交通造成的环境污染为目标,对综合信息技术、通信技术、自动控制技术等ITS相关技术的研究越来越多。越走越深。智能交通系统(ITS)应运而生并取得长足发展。ITS包括智能和交通两个方面,将先进的人工智能、信息技术和自动控制集成到整个交通管理系统中。协调建立实时、准确、高效的综合运输管理体系,充分利用交通设施,充分实现交通集约化发展。车辆识别技术是智能交通系统的重要组成部分,在交通违章监控与管理、公交优先系统、高速公路不停车收费、停车场监控与管理等系统中的需求越来越大。

国内外车辆识别主要采用的方法有:感应线圈法、超声波检测法、红外检测法、视频图像处理识别法等。基于视频图像处理的车辆识别系统,通过引入数码相机技术和计算机信息管理技术,采用先进的图像处理、模式识别、人工智能技术,通过对图像的采集和处理,获取丰富的信息,从而实现管理的高智能化水平。车辆识别系统已广泛应用于高速公路不停车充电、停车场监控管理、车辆检测等系统。作为智能交通系统中的一项关键技术,车辆识别技术在规范交通秩序、大型停车场管理、高速公路自动收费等诸多方面具有重要的理论和现实意义。1.2 国内外车辆识别技术研究现状 目前,国内外基于图像分析的车辆识别研究主要方向为:特征匹配算法车辆识别、神经网络车辆识别、支持向量机的车辆识别。与传统的车辆识别算法相比,基于特征匹配的车辆识别有很大的提升。在大多数天气条件下,不仅识别准确,而且计算量小,鲁棒性好,识别速度快,所以可以从根本上满足实时识别的要求,但是算法在复杂环境下不是很准确;神经网络是由模拟人脑智能的人工神经元组成的网络结构,具有良好的自学习、自适应和抗干扰能力。,但其研究与实际工程使用仍有一定差距;支持向量机是实现统计学习理论的一种通用学习方法,可以说是一种类似于神经网络的形式,这种方法可以更好地解决模型选择、学习问题、非线性和局部极小值等问题,但仍然存在从理论到应用的一些未解决的问题。神经网络是由模拟人脑智能的人工神经元组成的网络结构,具有良好的自学习、自适应和抗干扰能力。,但其研究与实际工程使用仍有一定差距;支持向量机是实现统计学习理论的一种通用学习方法,可以说是一种类似于神经网络的形式,这种方法可以较好地解决模型选择、学习问题、非线性和局部极小值等问题,但仍然存在从理论到应用的一些未解决的问题。神经网络是由模拟人脑智能的人工神经元组成的网络结构,具有良好的自学习、自适应和抗干扰能力。,但其研究与实际工程使用仍有一定差距;支持向量机是实现统计学习理论的一种通用学习方法,可以说是一种类似于神经网络的形式,这种方法可以较好地解决模型选择、学习问题、非线性和局部极小值等问题,但仍然存在从理论到应用的一些未解决的问题。但其研究与实际工程使用仍有一定差距;支持向量机是实现统计学习理论的一种通用学习方法,可以说是一种类似于神经网络的形式,这种方法可以较好地解决模型选择、学习问题、非线性和局部极小值等问题,但仍然存在从理论到应用的一些未解决的问题。但其研究与实际工程使用仍有一定差距;支持向量机是实现统计学习理论的一种通用学习方法在线识别车型,可以说是一种类似于神经网络的形式,这种方法可以较好地解决模型选择、学习问题、非线性和局部极小值等问题,但仍然存在从理论到应用的一些未解决的问题。

论文的研究范围属于基于神经网络的视频车辆分类技术。随着神经网络理论和图像处理技术应用的日益成熟,基于视频图像处理的技术应用在智能交通系统中发挥着越来越重要的作用。目前,基于神经网络的视频图像车辆分类方法大致可以分为以下两类:(1)基于神经网络的模板匹配方法。基于模板匹配的基本流程是:首先,目标车辆被二值化,并将其大小缩放到模型数据库模板的大小,然后与所有模板匹配,然后选择最佳匹配作为结果。优点是可以从当前拍摄角度的车辆实际外观的投影中识别出来。缺点是工作量巨大,学习过程繁琐,如果环境稍有变化,就需要重复整个学习过程。这种方法对光照、气候和其他因素的变化也很敏感。M. Dubuisson Jolly 等人。对模型进行分类,以结合先验知识的变形多边形为模板,采用贝叶斯决策确定模型,模型识别准确率可达91.9%。但是,该算法很复杂,需要大量的计算。魏等人。构建了一个相对简化的模型。参数模型用于表示车辆模型。模型参数包括车辆的最高点,拓扑结构等,然后应用神经网络识别车辆模型。车型识别率达到90%以上。该方法主要包括两个阶段:首先进行特征提取以识别目标车辆,然后利用获得的特征训练神经网络分类器。

该网络的识别效果与目标车辆的特征提取有关,往往比较耗时。相比之下,基于车辆图像特征的人工神经网络分类方法在准确性和鲁棒性上优于模板匹配方法。该方法将车辆样本图像视为一个矩阵,通过对该矩阵进行变换或线性投影,可以提取出车辆的代数特征。陈爱斌等。提出了一种基于KL变换的特征车辆识别方法。魏小鹏等。将人脸识别中的奇异值法应用于车辆识别。由于车辆样本图像是在室外采集的,图像的灰度变化很大,需要校正一个灰度一致性因子。T. Lim 等人。应用Gabor滤波器从车辆样本图像中提取Gabor特征,车辆识别效果较好。1.3 论文主要内容车辆识别技术是智能交通系统中的一项关键技术,其研究具有重要的理论和现实意义。本文的主题是基于BP神经网络的车辆识别。主要研究视频交通数据采集后的图像处理技术,包括车辆检测、特征提取和BP神经网络的设计。本文在理论分析和实验的基础上,了解了现有的一些方法,并在此基础上对车辆识别方法的关键技术进行了深入研究,得到了具有一定应用价值的车辆识别方法。第 1 章,简介。本章介绍了本课题的研究背景和意义、国内外研究现状以及论文的主要内容和结构。第 2 章,车辆目标检测。

首先对车辆图像进行预处理,然后利用背景差分法将运动车辆从背景中分离出来,然后进行阈值分割、形态学处理、连通域标记和填充,最后检测出运动车辆。第 3 章在线识别车型,车辆对象的特征提取。本章采用实时性好的Sobel算子进行边缘检测,并在此基础上进行特征提取。本专题选取的特征值有:顶长比、顶高比和前后比。第4章,BP网络设计和车辆识别。3-8-3 BP神经网络用于训练和测试输入特征值样本。基于Matlab平台,进行分组训练和测试验证,使训练后的网络稳定性好,识别时间短,识别率高。收到了很好的效果,最终达到了预期的目的。第五章,总结与展望。本章对本文的工作和成果进行了总结,并在取得的成果的基础上,提出了未来的工作和研究展望。第2章车辆目标检测2.1 基于视频图像的车辆车辆识别系统介绍图2-1为视频图像车辆识别的流程图。视频图像序列采集 视频图像序列采集 图像预处理 车辆目标检测图像 后续处理 车辆特征提取 分类判断输出 图2-1 车辆识别流程图1. 视频图像采集、数字化、并存储在内存中。2. 这些采集到的图像经过预处理,如:滤波去噪、图像锐化、对比度增强等。

3. 从捕获的图像中检测汽车。4. 对图像进行进一步的预处理,例如:阈值分割、填充等。 5. 对分割后的图像进行特征提取,用于车辆类型分类器。6. 将提取的特征应用于训练好的神经网络模型分类器。2.2 视频图像序列采集 由于本文需要利用车辆图像的侧面轮廓特征进行车辆识别和分类,因此可以将CCD摄像头安装在马路边或通道边,与车辆行驶方向成约 90 度角。拍摄速率可设置为10bps(每秒获取10帧移动车辆视频序列图像),获取的图像尺寸为192×256pixels。由于需要的是车辆的轮廓图像,因此只能提取并存储在场景中移动的车辆的连续四张图像。图 2-2 中捕获的视频序列图像显示了经过 'rgb2gray' 函数处理的灰度图像(即首先将捕获的 RGB 模式的彩色图像转换为灰度图像)。图2-2 视频序列图像2.3 车辆目标检测的常用方法本章的主要内容是静态背景条件下的车辆检测与分割,车辆检测与有效分割进行特征提取与最终车辆分类等价后处理很重要,因为后处理过程只考虑图像中与车辆运动区域相对应的像素。解决车辆检测算法的计算量和实时性之间的矛盾是提高系统检测精度和稳定性的关键。但在实际应用中,光照的变化、背景混沌运动的干扰、运动物体的阴影、摄像机和运动物体的抖动、自遮挡和互遮挡现象的存在都会影响车辆检测和分割的准确性。 . 在算法中必须考虑这些因素的影响及其去除方法。运动物体的阴影、摄像机的晃动和运动物体的自遮挡和互遮挡现象的存在会影响车辆检测和分割的准确性。在算法中必须考虑这些因素的影响及其去除方法。运动物体的阴影、摄像机的晃动和运动物体的自遮挡和互遮挡现象的存在会影响车辆检测和分割的准确性。在算法中必须考虑这些因素的影响及其去除方法。

下面简单总结一下目前常用的基于视频的车辆检测流程和方法。2.3.1 图像预处理数字图像预处理的目的是:1)去除图像采集过程中引入的噪声和干扰;2)删除背景次要图像信息中的所有夹杂物,以突出显示要识别的主要车辆图像,以供计算机分析和使用。预处理中使用了“平滑”和“锐化”等图像处理技术。1. 图像平滑 摄像头和抓帧器采集到的原车图像可能不满足目标识别的要求,所以需要对图像进行预处理,提高原车图像的效果,提高感兴趣区域。明晰。主要包括图像平滑和图像锐化。图像平滑也称为图像去噪。由于相机等因素,图像会受到不同程度的噪声污染,影响图像边缘信息的提取。因此,需要在提取车辆边缘信息和特征提取之前进行去噪处理。本文采用中值滤波方法去除噪声。中值滤波法是一种非线性平滑技术,将每个像素的灰度值设置为该点的某个邻域窗口内所有像素的所有灰度值的中值。在图像处理中,中值滤波常用于保护边缘信息,是平滑噪声的经典方法。实现方法:1) 从图像中的一个采样窗口取奇数个数据进行排序。2)将要处理的数据替换为排序后的中位数。在图像中使用中值滤波的基本原理:由于噪声是图像中的一些孤立点,这些点占据的像素较少,而图像中像素较多、面积较大的区域构成了图像的有效信息。

因此,如果将数字图像或数字序列中的某个点的值替换为该点邻域内每个点值的中值,则可以将周围的像素值逼近为真实值,从而消除孤立噪声点。本文采用上述滤波方法进行实验,结果如图2-3所示。具体过程如下: clear all% median filter i = imread('E:\mv\che.bmp');j =medfilt2(i);Figure,imshow(j)(a) noise image(b) median滤波后的图像 图2-3 原图和中值滤波后的图像对比2. 图像锐化 图像平滑降低了噪声的影响,但代价是模糊了图像的边界和轮廓,所以一般, 需要使用图像锐化技术来减少这种不利影响的影响,保证图像边缘的清晰度。图像锐化也分为时域和频域两种处理方式。从时域的角度来看,平滑图像模糊的根本原因在于图像的平均或积分运算。因此,为了使图像清晰,可以进行逆运算(例如微分运算)。从频域的角度来看,图像模糊的本质是其高频分量被衰减,因此可以使用高通滤波器使图像清晰。2.3.2 背景差分 最成熟、应用最广泛的运动目标检测方法主要有以下三种方法:帧差分法、光流法和背景差分法。本文采用基于背景差异的方法进行目标检测。

背景差分法是目前运动分割中最常用的方法。适用于相机静止或自然环境变化缓慢的情况。最简单的实现是从视频序列中预提取没有前景移动对象的帧图像。作为背景,使用当前帧与背景图像之间的差异来检测运动区域。这种差分方法对复杂背景下运动物体的检测效果较好。一般能提供最完整的特征数据,计算量小,实用价值大。基于背景差异的方法对图像进行分割。为了分割的目的,首先获得背景图像,我们称之为背景重建。这部分是图像分割的基础。当车辆不多时,可以将没有车时的图像作为背景,这是一种获取背景的方法。但是需要根据时间段将不同时间的背景图片存入数据库,然后根据当前时间读取背景图片作为背景。该方法前期工作量大,受周围环境影响大,鲁棒性差,需要在数据库中根据季节和日照时间建立背景信号模型。交通系统繁忙时,无法安装调试要求交通中断,不移动车辆也难以获取背景图像,因此系统必须依靠车辆行驶的图像来获取道路的背景图像。背景重建的简单原理如下:考虑到相机是固定的,背景图像变化较慢,而运动物体相对于背景变化较快,即背景像素的灰度值变化较慢,而运动物体对应的像素变化缓慢。灰度值变化比较快。而运动物体对应的像素变化缓慢。灰度值变化比较快。而运动物体对应的像素变化缓慢。灰度值变化比较快。

我们将每张图像分为两类区域:一、背景区域,由灰度值变化很小的像素组成;它由大像素点组成;前景区域包括当前帧中移动目标所在区域和前一帧中移动目标所在区域。这些区域像素点灰度值的具体处理过程如下: 设总和为采集到的两帧视频图像,使用帧间差分法对两帧的灰度进行差分处理图片。检测规则如下: If (2.1)If (2.2)其中T为阈值。然后加上处理后每个像素的灰度值,并将其除以被检测为属于背景的次数。这个值就是此时背景像素的灰度值。过程如下: >> video = imread('E:\mv\CHE0124.mpg',201:500);>> bg=video.frames(20) .cdata;bg_bw = rgb2gray(bg);thresh = 15;fr_size = size(bg);width = fr_size(2);height = fr_size(1);fg = zeros(height, width);对于 i = 21:51;fr = 视频 .frames(i).cdata;fr_bw = rgb2gray(fr);fr_diff = abs(double(fr_bw) - double(bg_bw));对于 j=1:k=1 的宽度:heightif ((fr_diff(k,j) 阈值 = 15; fr_size = size(bg);width = fr_size(2);height = fr_size(1);fg = zeros(height, width);for i = 21:51;fr = video .frames(i ).cdata; fr_bw = rgb2gray(fr); fr_diff = abs(double(fr_bw) - double(bg_bw)); for j=1:width for k=1:heightif ((fr_diff(k,j) 阈值 = 15; fr_size = size(bg);width = fr_size(2);height = fr_size(1);fg = zeros(height, width);for i = 21:51;fr = video .frames(i ).cdata; fr_bw = rgb2gray(fr); fr_diff = abs(double(fr_bw) - double(bg_bw)); for j=1:width for k=1:heightif ((fr_diff(k,j)

相关文章

- 基于神经网络BP的车型分类系统进行车型识别技术研究研究

- 2020全球最有价值的10大轮胎品牌,日本三个上榜

- 实力不容小窥大众旗下SUV这款

- 一汽-大众品牌将之称为“全新数字高尔夫”(组图)

- 车险新规要怎么买车险才比较划算(组图)急

- 大众新款13万左右上市,低价也能买到好车!

- 2017年汽车险种之一、自燃原因及处理方法汇总!

- 车辆保险中交强险怎么办?商业险怎么选?

- 宾利全球最大单一战略再提速三年内将推出首款纯电

- 大型车辆保险怎么买?网小编带您了解车险

- 连续6年没有出保险,我买的是车损险,三者100万

- 世界十大顶级昂贵音响排行榜,你的爱车上榜了吗?

- 学霸说保险,专注保险产品测评!国寿福臻享版如何?

- 12-18万SUV荣威RX5MAX的轴距排在3位

- 这三险买了不亏,得把钱花在“刀刃”上

- 16款美规版阿尔法罗密欧现车报价3.9S级

- 星越L雷神Hi·X混动版上市 三缸,不能绿牌是硬伤

- 补偿交付延期 智己汽车透露下一步规划

- 蜂巢能源与永杉锂业签约达成战略合作

- 《沦陷为玩物》刘惠梅汤金陵(完整小说)全文免费阅读【笔趣阁】

随机图文

-

吉利帝豪L Hi·X官图曝光 零百加速6.9秒

原标题:吉利帝豪L Hi·X官图曝光 零百加速6 9秒就在前几天吉利刚刚曝光了帝豪L Hi·X的路测谍照。据悉新车将搭载1 5 -

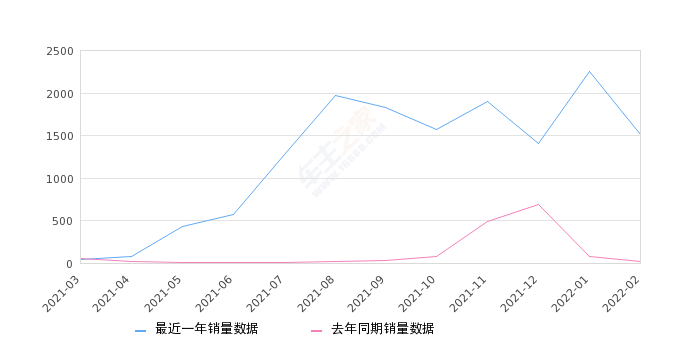

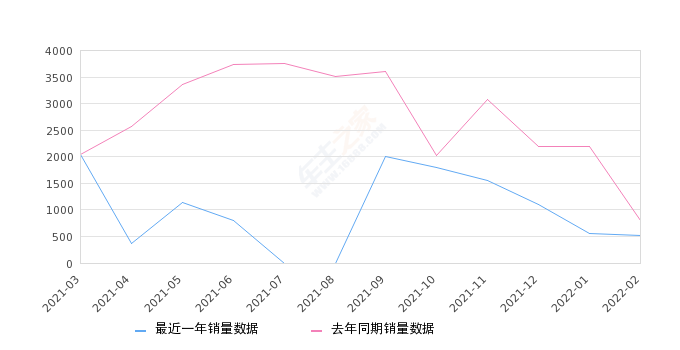

2022年2月份风行S50EV销量2736台, 同比增长15994.12%

原标题:2022年2月份风行S50EV销量2736台, 同比增长15994 12% -

21款奔驰G550越野霸主经典三把差速锁配置升级

21款奔驰G550越野霸主,经典三把差速锁配置升级,奔驰G550虽然外观风格未变,大灯复古的圆形造型。但最新款奔驰G550还是在大灯下方加入了时... -

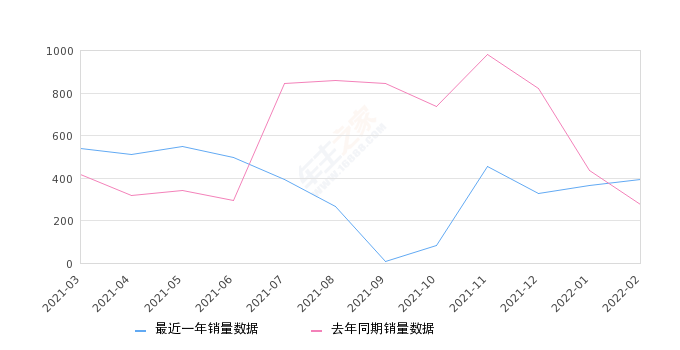

2022年2月份奥迪A6L新能源销量391台, 同比增长42.18%

原标题:2022年2月份奥迪A6L新能源销量391台, 同比增长42 18% -

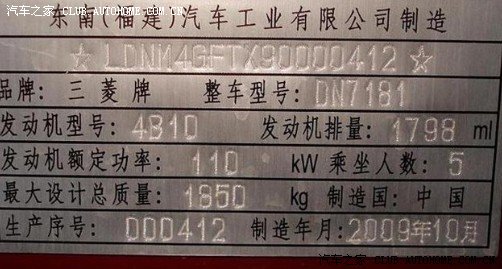

汽车基本特征怎么样?异地过户的几种方法,值得一看!

看车型大致也可以判断那一年的车。并通过获取的车辆参数如车辆尺寸、排量、发动机型号、生产日期、驱动方式、车辆配置等,来核对车辆车型车... -

汽车模拟驾驶 HYM-9A型密度板外壳、22寸液晶显示屏

是目前市场上绝对最新版的汽车驾驶模拟器软件。汽车模拟技术第二节汽车驾驶模拟器软件技术指标汽车驾驶模拟器驾驶模拟软件采用汽车多自由... -

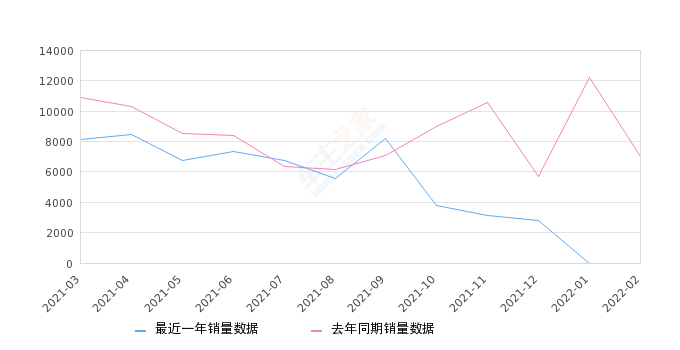

2022年2月份吉利icon销量527台, 同比下降33.71%

原标题:2022年2月份吉利icon销量527台, 同比下降33 71% -

2022年2月份长安CS35销量2002台, 同比下降71.49%

原标题:2022年2月份长安CS35销量2002台, 同比下降71 49%